Le tournoi de Roland-Garros permet à la Direction de l’Innovation et aux équipes éditoriales de la Direction des Sports de tester l’évolution de ces nouveaux formats et d’en évaluer le potentiel au sein des futures offres de France Télévisions.

Le RGLab offre aussi cette formidable opportunité de recevoir un grand nombre de professionnels du broadcast et du numérique, mais également de partenaires technologiques, de la régie publicitaire de France Télévisions et de la direction de la FFT, avec lesquels nous échangeons sur l’évolution des usages et le futur de la télévision pour inventer les services de demain avec, notamment, une mission : Comment améliorer l’expérience et renouveler l’offre à destination d’un public jeune qui se détourne traditionnellement de la télévision linéaire classique.

Plusieurs prototypes fonctionnels ont été présentés lors de ce RGLab et permettaient de tester les différents cas d’usages sur les derniers casques de réalité mixte et sur écran 3D combinant les avancées en matière d’intelligence artificielle, spatial computing et vidéo 3D. Ces expériences complètent les travaux menés lors des précédentes éditions sur les espaces immersifs et permettent d’explorer les nouvelles façons d’exploiter les contenus du tournoi et d’interagir avec eux.

Le Vision Pro : une révolution immersive au RGLAB 2024

Pour l'édition 2024 du RGLAB, la Direction de l'Innovation de France Télévisions présente son premier démonstrateur sur le casque Vision Pro d’Apple. Cette application innovante illustre les capacités du casque et la diversité des options de contenus et d'expériences offertes par ce type de support, notamment en matière de réalité mixte, virtuelle et de spatial computing.

Parmi les fonctionnalités phares de cette application, on retrouve le multi-courts. Cette fonctionnalité permet à l'utilisateur de choisir, via une carte 3D du stade de Roland Garros, le court qu'il souhaite regarder en direct sur des écrans virtuels de grande résolution qui s'intègrent dans l'environnement réel. En complément, deux versions de restitutions de matchs en 3D sont proposées : une première version avec des personnages animés et des gestes simplifiés basés sur la position des joueurs et la trajectoire de la balle, et une seconde version avec une capture de mouvement complète (full motion capture) offrant une plus grande précision des mouvements des joueurs. Les utilisateurs peuvent également vivre cette expérience en taille réelle, en étant immergés dans le court Philippe Chatrier en 3D. L'application intègre également de la vidéo convertie au format spatial vidéo sur la plateforme Immersity AI de Leia Inc., permettant de visionner les matchs en stéréoscopie.

Ces expériences tirent pleinement parti des capacités du Vision Pro, notamment la manipulation de l'interface grâce au eye et hand tracking et une qualité de rendu vidéo exceptionnelle, permettant de profiter d'une réalité mixte immersive depuis la terrasse du RGLab.

Cependant, il est important de noter que le casque Vision Pro présente également quelques défauts notables. Son prix élevé, son poids relativement important et un confort qui n'est pas encore optimal peuvent représenter des obstacles pour certains utilisateurs. Malgré ces limitations, ce démonstrateur ouvre la voie à l'avenir de l'expérience spectateur, où les casques et lunettes connectées permettront à chacun de personnaliser son expérience et son environnement avec des écrans et éléments interactifs en 3D. Grâce à cette technologie, le Vision Pro offre un aperçu fascinant des futurs modes de consommation de contenus sportifs, rendant l'expérience de visionnage plus personnalisable, plus interactive et immersive que jamais.

Le tournoi sur Quest 3

Avec l’introduction du casque Quest 3 de Meta, une nouvelle fonctionnalité est apparue qui va révolutionner la façon dont nous percevons et utilisons les casques de réalité virtuelle pour le grand public. Le Quest 3, grâce à deux caméras couleur ajoutées à l’avant, offre la fonction “Passthrough”. Cette fonction transforme le casque VR en un casque de réalité mixte, éliminant ainsi l’un des principaux inconvénients souvent associés aux casques VR : l’isolement. Les deux caméras couleur, stratégiquement placées, permettent de voir le monde extérieur directement à l’intérieur du casque, offrant une vision continue de l’environnement réel même avec le casque sur les yeux. L’atout majeur de cette technologie est qu’elle permet de superposer des éléments virtuels à la réalité, donnant l’impression que ces objets virtuels font partie intégrante du monde réel. Ainsi, la réalité mixte, qui est un mélange de réalité et de réalité virtuelle, devient accessible à tous.

Maintenant que la réalité mixte est disponible pour tout un chacun, notre équipe s’est penchée sur la question pour proposer au RGLab des expériences concrètes qui préfigurent le type d’application et de service que France Télévisions pourrait offrir en réalité mixte, dans un futur proche ou lointain. Deux applications ont été développées, l’une avec une approche de service et l’autre plus ludique, comportant différents types de contenu.

Le “Multi-Courts” : Une application qui représente une offre de service que France Télévisions pourrait envisager dans un futur proche. Spécifiquement conçue pour Roland-Garros, elle offre la possibilité de suivre l’ensemble des matchs en direct à travers des écrans virtuels flottants que l’on peut déplacer et agrandir à volonté, pour les positionner où l’on souhaite. Le choix du flux se fait en interagissant avec une carte 3D de Roland-Garros, également flottante et déplaçable à volonté, qui permet d’ouvrir le flux correspondant au court sélectionné. Jusqu’à trois écrans peuvent être ouverts simultanément, permettant de suivre trois matchs en même temps tout en bénéficiant du son uniquement de l’écran que l’on regarde. Cette application concrète pourrait rapidement être mise en production pour offrir des expériences enrichissantes à nos téléspectateurs.

Le “Tournoi” : Un prototype qui pousse l’exploration de la réalité mixte un peu plus loin, en mettant en avant les interactions physiques possibles avec l’ensemble des objets virtuels disponibles, parfaitement intégrés dans notre environnement. Nous avons ainsi offert la possibilité de manipuler avec ses mains des objets virtuels tels que des balles de tennis ou des miniatures des coupes des vainqueurs, démontrant la gestion de la physique et les interactions naturelles. De nombreuses activités sont proposées, comme la visualisation d’un joueur de tennis en mouvement, capturé en vidéo volumétrique, offrant un résultat incroyablement réaliste à l’échelle 1 ! La possibilité de visualiser sous forme de miniature un véritable échange d’un match de Roland-Garros en motion capture. Mais aussi différents “easter eggs”, comme la possibilité de briser virtuellement nos murs environnants pour laisser entrevoir le court Philippe Chatrier modélisé en 3D, donnant l’impression que notre salon est en fait en plein milieu du court !

Ces prototypes sont des exemples qui mettent en évidence le potentiel de la réalité mixte et montrent que, au fur et à mesure de son déploiement chez les utilisateurs, cette technologie deviendra certainement incontournable ! En mélangeant le virtuel à notre quotidien, la réalité mixte fait disparaître la frontière entre le réel et le virtuel.

Conversion vidéo 2D vers 3D

France Télévisions s’est associé au partenaire technologique américain, Leia Inc., rencontré lors du dernier CES de Las Vegas. La technologie développée par Leia Inc. rend la 3D accessible à tous sans besoin de lunettes, grâce à une combinaison d'innovations matérielles, telles que les lentilles commutables 2D-3D et le suivi du regard (eye-tracking), et logicielles.

Leia Inc. a développé une série de plugins professionnels pour Unity et Unreal, ainsi qu'un SDK polyvalent incluant un SDK Media pour une conversion transparente de la 2D à la 3D, et divers outils XR et applications 3D, comme le lecteur vidéo 3D 4K-8K, la visualisation de modèles 3D, et le chat vidéo 3D.

De plus, les écrans LeiaSR™ de 6 à 32 pouces, prennent en charge aussi bien les technologies LCD que OLED, et garantissent une expérience visuelle sans compromis en 2D et 3D, sans aucune perte de luminosité ni d’images fantômes. La démonstration présentée au RG Lab permettait de revivre une séquence de match capturée en 8K/2D et restituée sur un écran LeiaSR™ de 32 pouces en 3D, offrant une qualité de visionnage exceptionnelle et une immersion totale sur le court Philippe Chatrier.

Grâce à son partenariat avec Leia Inc., France Télévisions explore également la conversion de contenus vidéo 2D vers la 3D via la plateforme web Immersity AI. Cela permet de visionner des matchs en 3D de manière quasi immédiate dans différents formats (HD, 4K, 8K, ou encore le format vidéo spatial) sur des écrans 3D sans lunettes,intégrant la technologie d’IA de Leia Inc. La technologie Immersity via l’IA est capable de détecter et d’améliorer les différents plans d’une vidéo et d’utiliser ces informations pour améliorer l'effet de profondeur.

Cette technologie d’écrans 3D, bientôt accessible au grand public sur PC ainsi que sur smartphone Android, facilitera l'accès à une expérience immersive en 3D, notamment dans les domaines du sport, du gaming ou du cinéma. Une nouvelle ère de divertissement immersif sans casque est à portée de main. L’expérience reste à construire !

Production virtuelle et Gaussian Splatting

La technologie 3D Gaussian Splatting, récemment mise en lumière par les travaux de l’INRIA, permet de capturer le monde réel, que ce soit un objet ou un lieu, à partir de vidéos ou de photos prises sous de nombreux angles différents. Cette technologie transforme ensuite ces images en un modèle 3D photoréaliste qui peut être intégré dans des moteurs de rendu 3D tels qu’Unreal Engine ou Unity. Contrairement aux objets 3D traditionnels qui sont constitués de polygones, le modèle 3D créé par le Gaussian Splatting est composé d’un nuage de points.

Chaque point est rendu comme une petite “tache” (ou “splat”) de couleur diffuse, plus ou moins étendue, et l’ensemble superposé de ces “taches” permet d’obtenir l’image de l’objet ou du lieu capturé sous n’importe quel angle de vue. Pour obtenir ce résultat, le nuage de points est entraîné en comparant les images réelles de la prise de vue, jusqu’à obtenir un résultat satisfaisant. Chaque “tache” est régie par une courbe gaussienne qui définit son rendu (couleur, transparence, taille, forme) en fonction du point de vue. Cette particularité permet de capturer comment la lumière se comporte sur différentes surfaces, qu’elles soient réfléchissantes (comme le métal ou le miroir) ou transparentes avec leur refraction.

Pour cette édition du RGLab, nous avons mis en avant cette technologie en créant un décor de production virtuelle en “Gaussian Splatting”. Nous avons pris des photos du court Philippe Chatrier et, grâce à cette technologie et à l’expertise du CEA-List, nous avons recréé un modèle 3D du court que nous avons intégré comme décor virtuel. Au RGLab, nous avons installé un fond vert devant lequel les visiteurs peuvent être filmés, donnant l’impression d’être réellement sur la terre battue du court Philippe Chatrier, grâce notamment au réalisme saisissant offert par le Gaussian Splatting. Pour une immersion encore plus grande au cœur de Roland-Garros, nous avons offert la possibilité de soulever la Coupe des Mousquetaires ou la Coupe Suzanne-Lenglen (des modèles réalisés en 3D conventionnelle), grâce à un “tracker” du système Vive Mars Camtrack.

Cette technologie peut être utilisée dans de nombreuses autres situations, comme la reproduction d’objets pour la réalité augmentée ou la création de visites virtuelles de lieux emblématiques avec un résultat proche de la réalité.

IA Agent conversationnel

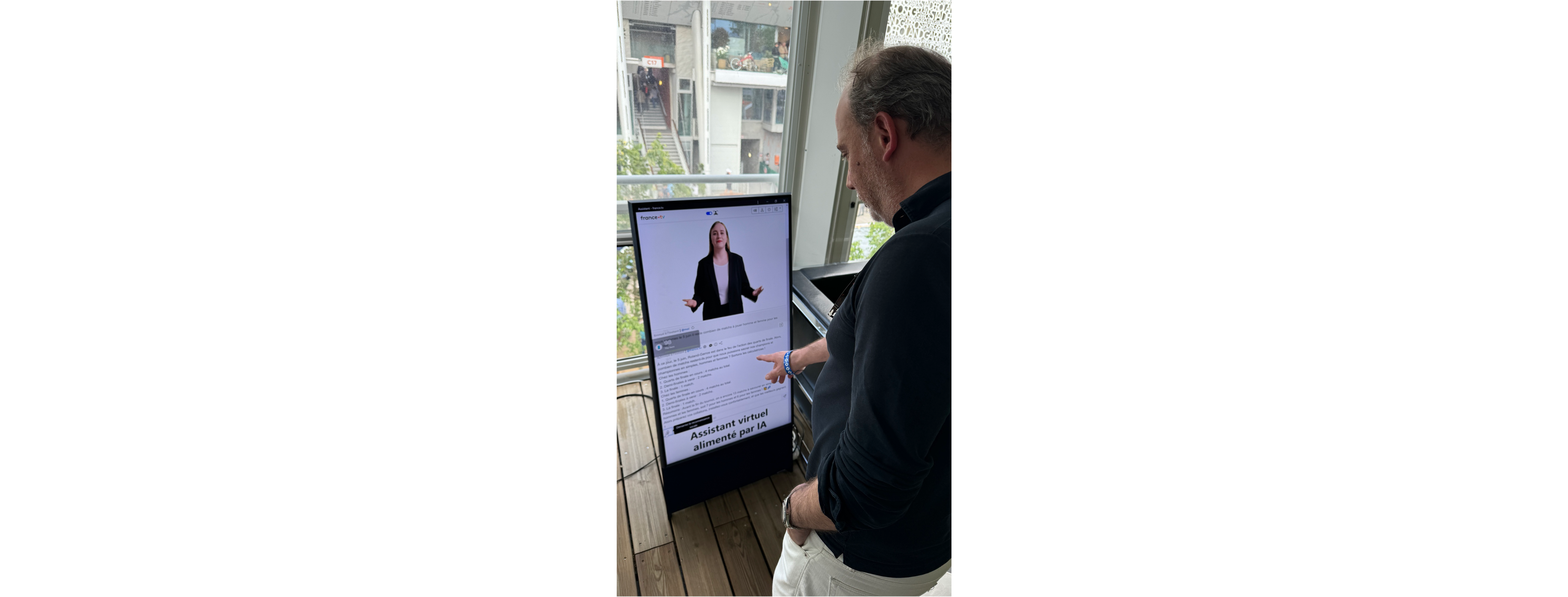

Dans la poursuite des recherches autour de l’intelligence artificielle et des avatars, la direction innovation a développé un agent conversationnel, sous la forme d’un avatar vidéo réaliste, permettant de répondre aux questions autour du tennis et de l’actualité du tournoi. Cet agent conversationnel est connecté aux différents LLM du marché et exploite un ensemble de données provenant notamment des sites de référence (franceinfo, FFT...).

Comment ça marche ? Différentes briques technologiques ont été agrégées pour permettre de réaliser ce chatbot vidéo qui permet d’interagir et de poser des questions à un avatar réaliste. Une première brique « speech to text » qui utilise Whisper ASR (OpenAI) permet de transcrire la demande orale de l’utilisateur sous forme de texte qui alimentera le prompt envoyé au LLM sélectionné. En effet, ce démonstrateur permet de sélectionner différents LLM du marché (ChatGPT, Gemini, Mistral, LLaMa, Claude, Palm2…) pour tester les différents niveaux de réponse et, notamment, la pertinence et la rapidité des réponses envoyées. Pour améliorer la qualité des réponses et la fraîcheur des données, une RAG (Retrieval Augmented Generation) a été mise en place au sein du démonstrateur. Cette base de données vectorielle permet d'enrichir le prompt avec des données récentes et vérifiées provenant de sites de référence sélectionnés, afin d'améliorer la fiabilité des réponses du LLM. En fonction des demandes utilisateur, celui-ci peut également interroger en temps réel la base de résultats de la FFT pour compléter ses réponses aux utilisateurs. La réponse formatée par le LLM en fonction des critères choisis (taille de la réponse, ton de la réponse, langue de la réponse…) est ensuite envoyée à la plateforme HEYGEN qui convertit la réponse texte en vocal (« speech to text ») et génère une vidéo d'avatar photoréaliste qui est diffusée en direct à l'utilisateur (via webRTC).

L’étude d’un tel dispositif nous permet, notamment, d’étudier les différentes problématiques liées à l’utilisation de ces technologies d’intelligence artificielle générative (coûts, fiabilité, éthique, hallucination…) avant d’envisager le déploiement d’un tel agent conversationnel au sein des services numériques de France Télévisions qui en exprimeraient le besoin.

À propos de Leia Inc.

Leia Inc. propose la seule technologie offrant des expériences immersives aux consommateurs sur n'importe quel appareil, dès aujourd'hui. Grâce à sa plateforme hardware intégrée, de logiciel et d'intelligence artificielle fonctionnant ensemble, les écrans commutables LeiaSR de 2D à 3D offrent une immersion inégalée. De plus, son application web Immersity AI, construite sur la technologie Neural Depth, transforme le contenu en contenu immersif en convertissant les images et les vidéos en 3D.

À propos du CEA

Le CEA-List est l’un des trois instituts de la direction de la Recherche technologique du CEA. Experts dans le domaine des systèmes numériques intelligents, le CEA-List soutien la compétitivité des entreprises par le transfert technologique et l’innovations vers le monde industriel.

Retour

Retour

R&D

R&D