La vidéo 360°

La vidéo 360°, ou vidéo immersive, vous permet de ne plus seulement regarder passivement un contenu vidéo en suivant le choix des plans de caméras du réalisateur, mais de vous glisser pleinement au cœur d’un lieu et de choisir vous même où vous regardez. Lisible depuis tout type de terminal, elle peut être visionnée aussi bien sur un ordinateur que sur un téléphone portable : il vous suffit de déplacer votre téléphone pour changer de manière transparente l’angle de vue, comme si vous filmiez vous-même.

Muni d’un casque de réalité virtuelle comme le modeste Google Cardboard en carton ou le plus haut de gamme Samsung Gear VR, vous avez l’impression de prendre place dans la scène comme si vous y étiez.

Les limitations des technologies actuelles

Nous avons dès 2016 augmenté la qualité de nos contenus 360° visionnables en direct chez l’utilisateur pour atteindre une résolution 4K (4096x2048, soit peu ou prou la même résolution que les écrans 4K / UHD).Ceci nous a permis d’obtenir un certain confort de lecture sur les terminaux mobiles : l’écran des téléphones restant petit, l’œil y perçoit peu le nombre de pixels et leur déformation. Mais lire le même contenu 360° sur un grand écran comme une TV ou dans un casque de réalité virtuelle plus confortable comme le Samsung Gear VR s’est avéré être autrement plus fatiguant pour nos yeux. Et pourtant, nous parlons bien d’une résolution 4K, la même que celle des images magnifiques que nous pouvons parfois voir sur les télévisions haut de gamme — si vous n’en avez jamais vu, allez chez votre vendeur d’électronique préféré voir les dernières télés, cela vaut le détour ! Essayons de comprendre pourquoi il existe une telle différence.

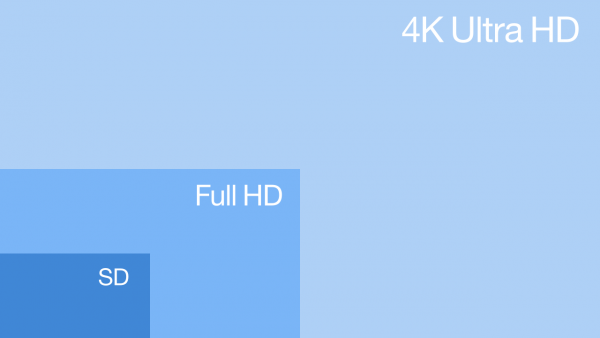

Avec une vidéo traditionnelle non 360°, le problème est trivial : le nombre total de pixels contenus dans la vidéo (la résolution) correspond exactement au nombre de pixels que vous voyez sur votre écran. Sur un ancien écran de TV non-HD comme nous en avions tous il y a ne serait-ce qu’une quinzaine d’années, regarder une image SD (720x576) de très près vous permettrait, si vous ne tenez pas à vos yeux, de compter les pixels individuellement : 720 horizontaux, 576 verticaux. Il en va de même avec la HD (1920x1080) et la UHD (3840x2160), même si les pixels sont plus difficilement visibles à l’œil nu.

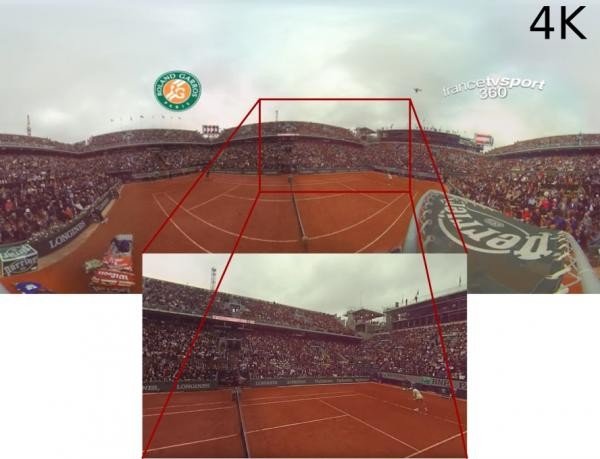

Avec une vidéo 360, le calcul est tout autre ! En effet, l’intégralité de la sphère virtuelle — devant vous, derrière vous, sur vos côtés, en bas, en haut — est empaquetée dans un format vidéo traditionnel rectangulaire dans un style ressemblant fort aux panoramas photos des années 2000.

Voici à quoi ressemble une vidéo 360 dans son intégralité :

On remarque au passage qu’il s’agit du même principe pour représenter la planète Terre, sphérique, dans une carte du monde tenant sur une feuille rectangulaire : les fondements mathématiques n’ont en fait rien de nouveau !

Dans ce format, que l’on appelle format équirectangulaire ou encore format sphérique, nous sommes bien dans le cas classique vu plus haut où le nombre de pixels contenus dans la vidéo correspond au nombre de pixels que l’on peut voir sur l’écran : ici 4K au maximum. Notez que pour voir la vidéo ci-dessus en 4K, il vous faudra un écran compatible et une forte bande passante.

Mais pour profiter pleinement de la vidéo 360° et ne pas jouer au caméléon qui voit derrière sa tête, il faut que le lecteur vidéo comprenne qu’il s’agit d’une vidéo 360° et la reprojette correctement à l’écran pour que nous n’en voyions qu’une partie. Nous pouvons ainsi nous promener dans l’image et choisir notre point de vue, mais en contrepartie nous ne regardons qu’une petite partie de l’image disponible ! Nous profitons en réalité d’environ 1/8e de la résolution lue par le lecteur vidéo, soit un très mauvais HD-Ready (1280x720) avec en prime une déformation des pixels. La visionner sur un écran de TV 10 fois plus grand qu’un téléphone ou dans un casque de réalité virtuelle à quelques centimètres de vos yeux exacerbe grandement les défauts alors visibles.

Pour obtenir une image qui pourrait flatter la rétine et atteindre les limites de l’œil humain dans un casque de réalité virtuelle, il est couramment estimé qu’il faudrait une image de 16K (16384x8096) voire 32K (32768x16384) ! C’est bien entendu inimaginable : la puissance nécessaire serait gigantesque et la bande passante requise démesurée. Tout cela pour regarder seulement un huitième de l’image, quel gâchis…

L’encodage en “tuiles”

À la Direction de l’Innovation et de la Prospective, pendant que nous passions le relaisde la vidéo 360 4K aux équipes de production de France Télévisions avec Roland-Garros VR, nous avons étudié et testé des moyens de monter encore en résolution tout en restant dans des contraintes de puissance et de débit acceptables pour le grand public, en nous associant au savoir-faire de sociétés reconnues dans le milieu comme Harmonic ou Ateme et avec l’aide précieuse de producteurs comme Bemersive ou Digital Immersion.

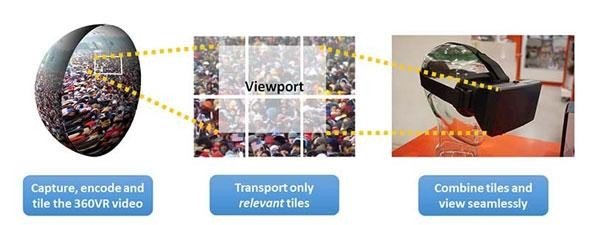

Une méthode consiste à “prédécouper” une vidéo 360° en de nombreux morceaux appelés “tuiles” qui composent chacune un petit angle de vue. Le lecteur vidéo 360 viendra ensuite, de manière dynamique en fonction de l’orientation de l’utilisateur, télécharger et décoder seulement les tuiles qui rentrent dans le champ de vision. Toutes les autres tuiles qui sortent du champ de vision ne sont pas téléchargées, économisant ainsi une précieuse bande passante et puissance processeur.

Si l’utilisateur décide de tourner son téléphone, changeant ainsi l’angle de vue, alors les nouvelles tuiles seront téléchargées et les anciennes ignorées. Des techniques d’optimisation sont alors indispensables pour ne pas avoir un écran noir ou figé pendant deux à trois secondes, comme c’est le cas habituellement avec les technologies de streaming classiques, par exemple quand lorsque l’on charge une nouvelle vidéo sur france.tv ou Youtube. L’une d’entre elles est de télécharger de manière continue une version très basse définition de l’intégralité de la sphère pour l’utiliser de manière classique si l’utilisateur tourne rapidement la tête, en attendant que les tuiles haute résolution soient chargées.

Nous avons pu tester pendant Roland-Garros 2017 la réalisation de deux tournages de vidéo 360° en 8K et 16K, que nous avons ensuite encodées et — après plusieurs jours de calculs — exposées sur des casques de Réalité Virtuelle et des écrans TV géants.

L’autre avantage non négligeable de cette technique d’optimisation est qu’elle permet à un plus grand nombre d’utilisateurs de bénéficier de la résolution 4K en diminuant la bande passante nécessaire : en utilisant le même procédé sur une vidéo 360° 4K, on peut diviser le débit nécessaire à la visualisation de la vidéo par presque 4 pour atteindre environ le débit d’une vidéo Full HD (1080p) classique, et ainsi permettre à tous les utilisateurs qui n’avaient auparavant pas la bande passante nécessaire pour regarder une vidéo 4K 360° « classique » de profiter tout de même de l’amélioration de la qualité.

Les lecteurs les plus « techniques » d’entre vous pourront aller lire la présentation en anglais des résultats des travaux de GPAC, notamment soutenu par l’Institut Mines Télécom, sur le sujet au travers d’une implémentation Dash complété par Ateme, ou encore la présentation en anglais sur le site de Tiledmedia de leur technologie complétée par Harmonic.

Et chez France Télévisions ?

Bien que cette technique soit prometteuse, il n’existe encore aujourd’hui pas ou peu de solutions commerciales pour la déployer de manière industrielle pour France Télévisions. Différents acteurs travaillent à la fiabilisation de leur produit et à la diminution de la puissance nécessaire — il faut à l’heure où nous écrivons ces lignes des téléphones puissants et récents pour pouvoir en profiter — et pourraient bientôt proposer leur technologie à des distributeurs comme France Télévisions, qui grâce à ces acteurs pourrait bientôt continuer ses expérimentations à une plus grande échelle.

Nous noterons cependant la complexité de mise en place d’une telle méthode. L’intégration du support des vidéos 360 classiques peut se faire assez simplement sans avoir à changer l’intégralité de l’infrastructure existante — nous l’avons vu : il s’agit de vidéos “rectangulaires” classiques, de telle sorte que les encodeurs, espaces de stockage, réseaux de diffusion de contenu (CDN), décodeurs, etc., ne savent en réalité pas qu’il s’agit de vidéo 360 et seul le lecteur vidéo doit travailler pour afficher la bonne partie de l’image.

A contrario, la mise en place de techniques de tuiles nécessite de changer et repenser une bonne partie de l’infrastructure, pouvant potentiellement engendrer des coûts initiaux de mise en place bien plus importants.

Enfin, bien que ce point n’ait pas été abordé dans cet article, la captation en 16K tout au moins pour le direct nécessite encore aujourd’hui des ensembles de caméras et de serveurs à très haut budget, limitant pour le moment la démocratisation de ces technologies, avant que la loi de Moore ne fasse son effet au fur et à mesure du temps.

Retour

Retour

R&D

R&D